OpenCode Go を利用してみた

普段は Codex / Claude Code / Copilot を利用していますが、Copilot が従量課金になることもあり、あまり今まで触れてこなかったモデルに触れてみようと思い、OpenCode Go を使ってみたので、雑に書いて行きます。

Cursor の Composer 2 Fast (MAX)

2026 年に入ってから Anthropic や OpenAI 以外のモデルも触っておいた方が良いだろうと考え、Cursor の Composer 2 というモデルを1ヶ月利用し続けてみました。

Composer 2 は Fast モードかつ MAX で利用しており、主にソースコード調査で利用していましたが、とにかく早くてあまり間違えないというのはかなり体験としてよかったです。この Composer 2 はとても安くて、 Cursor の Pro+ プランで Composer 2 Fast (MAX) を使いまくったとしても、利用制限を意識する必要が全くないレベルで使い続けられるのはとても快適でした。1ヶ月で約 13.6億 tokens 使っていましたが、利用数は 77% 程度で本当に気軽に利用できました。

この Composer 2 はどうやら Moonshot AI の Kimi 2.5 ベースということで、Kimi 2.5 がなんとなく気になっていました。

Kimi 2.6 と DeepSeek v4 Pro

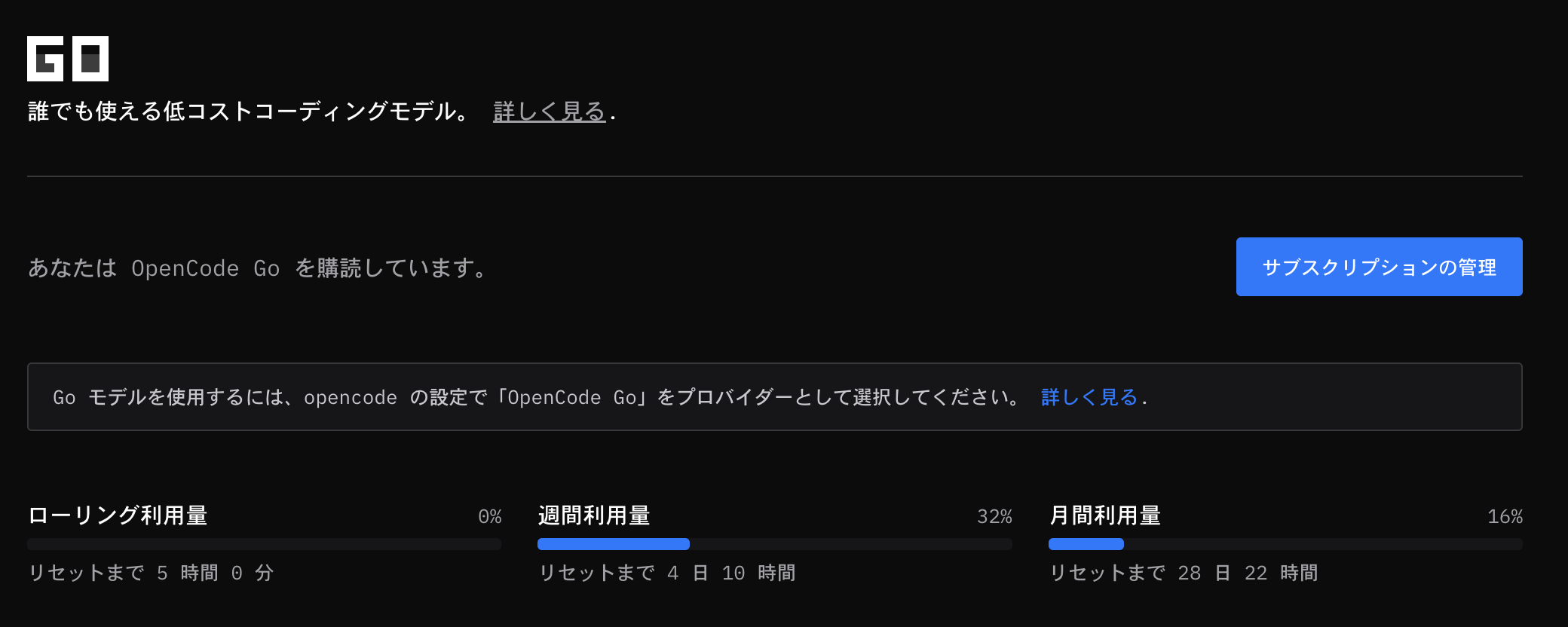

そんな中、Kimi 2.6 と DeepSeek v4 Pro などが次々と発表されて、いい機会なので触ってみるかと思い色々調べていました。自分で動かすというのはちょっとコスト的にメリットがないので、できればオープンソースのモデルをホスティングして提供してくれているサービスがいいなと思い調べてみたら、ちょうど OpenCode の Go というサービスが、月 10 ドルで Kimi 2.6 は DeepSeek v4 Pro がある程度利用できることがわかり触ってみることにしました。ちなみに最初の月は 5 ドルです。

OpenCode Go

OpenCode は OSS のエージェントで Copilot が利用できるくらいの認識でいたのですが、どうやら時前でのホスティングも提供しているようでした。

月 5 ドルで始められるということで、早速 Kimi 2.6 と DeepSeek v4 Pro を試してみました。

利用できる一般的なオープンソースとして公開されているモデルのようです。この辺りは明るくないので詳細は公式サイトをどうぞ。

Kimi 2.6

まず Kimi 2.6 の感想ですが、かなり良いなという印象です。

- レビューは Opus 4.7 と比較しても違和感ない内容

- コードは Opus 4.7 よりちょっとミスが多い

- 調査は Opus 4.7 と比較しても早い内容もあまり差が感じられない

コスト面では Opus 4.7 と比較すると ...

Kimi 2.6: Input $0.95 / Output $4.00 / Cached Read $0.16

Opus 4.7: Input $5.00 / Output $25.00 / Cached Read $0.50

従量課金だとしても 1/5 くらいの価格で利用できるので、悪くない印象です。

実際に色々と試してみましたが、Opus 4.7 の代わりに利用するのも現実的な気がします。ただ注意点としてはコンテキストサイズは 25 万程度なので、1M は非対応です。

DeepSeek v4 Pro

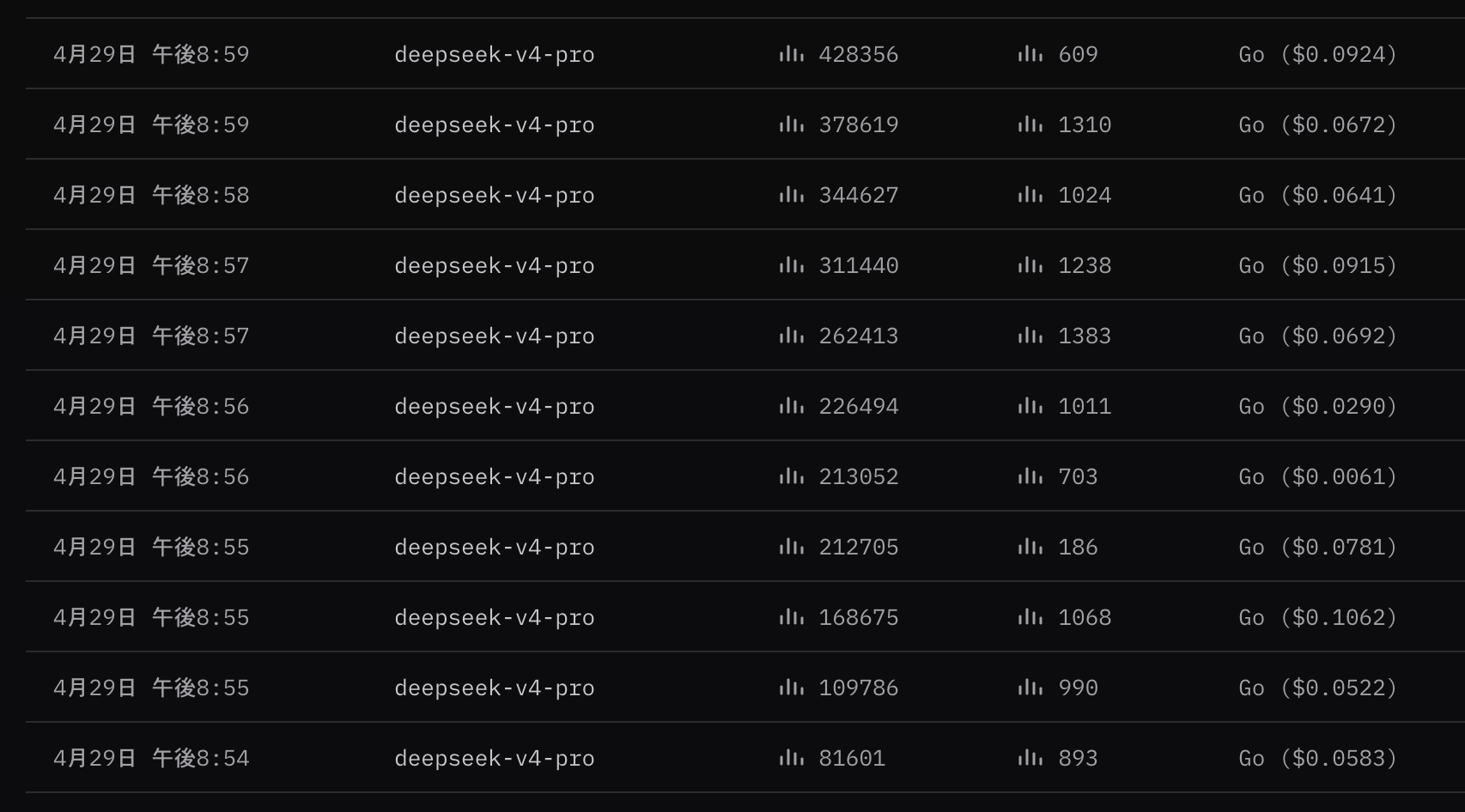

1M 対応ということで、これはレビューに最適なのでは?と思い色々と試してみました。感想としては Kimi 2.6 よりいいという感じはしなかったです。ただ、とにかく 1M 持ってる状態で「レビューをしつこく何度もさせる」のが強いなと思いました。

雑に 100 回レビューしてといってもモリモリレビューしてくれます、使用率も全然へりません。そして何度も何度もレビューさせる結果はとても良い感触です。

Opus 4.7 や GPT 5.5 でレビューをゴリゴリ回すと結構な勢いで溶けていくので、コレは良いなと思いました。

Qwen3.6 Plus

OpenCode Go で利用できたので、Qwen3.6 Plus も試してみました。感想としては早くていい。Composer 2 Fast を使っているのと似ている感じです。早いは正義。ただレビューはしっくりこなかったので、調査用にいいなと思いました。

当倍速です

さくさくです。

まとめ

OpenCode Go でいろいろなモデルを触ってみましたが、正直かなり良いなと言う印象です。オープンソースモデルということもあり、ローカルでの運用も頑張ればできるのでしょうけど、それよりは OpenCode などのプロバイダーを利用するのが現実的だなと実感しました。

自分はとにかく調査やレビューに LLM を利用したいというのが強くあるので、今回の Kimi 2.6 や DeepSeek v4 Pro や Qwen3.6 Plus はとても好印象です。